阿西莫夫机器人三定律详解 无人驾驶汽车监管启示

视频介绍

阿西莫夫机器人三大定律是什么

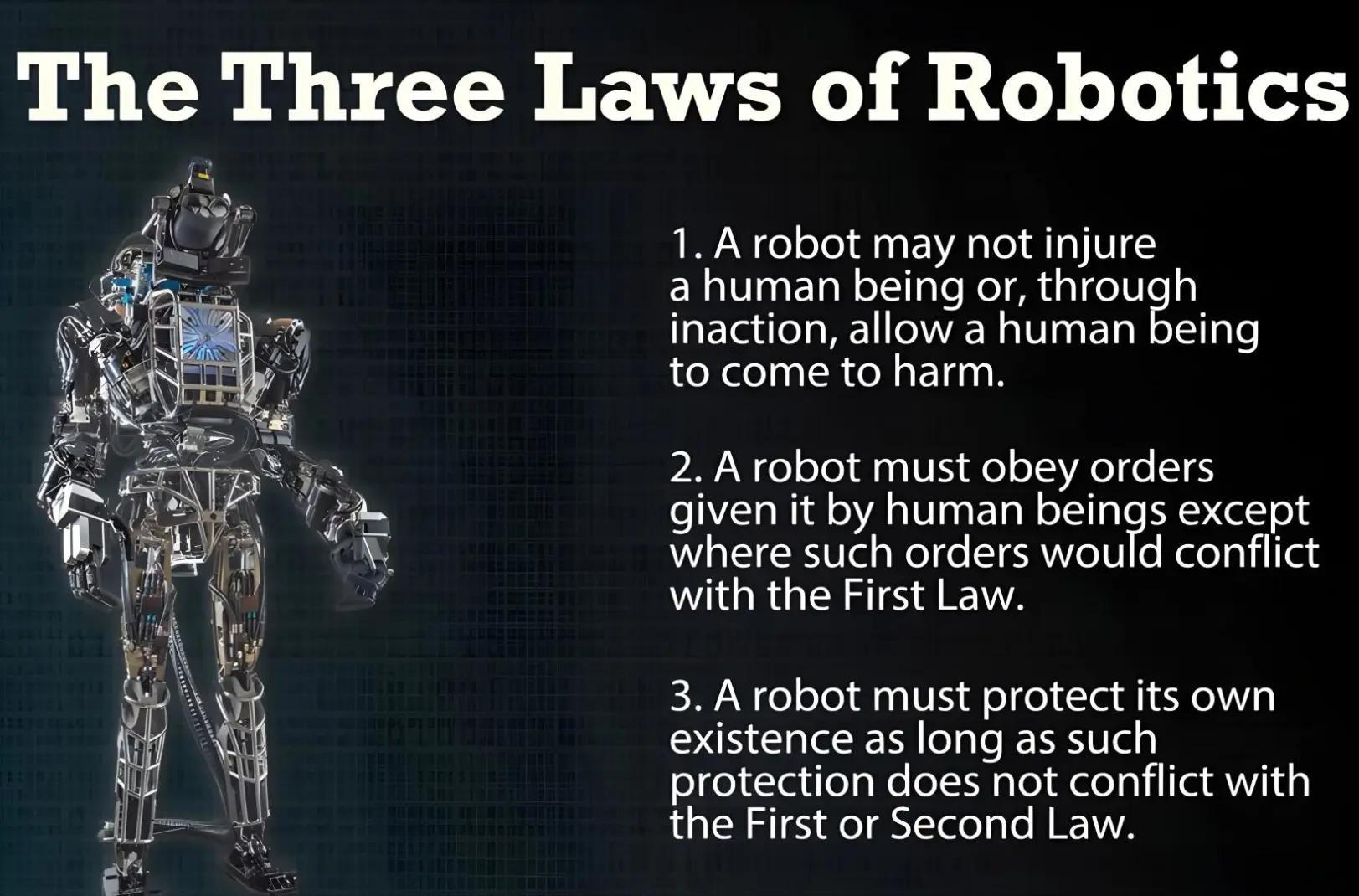

哎呀,说到机器人伦理就不得不提传奇科幻作家阿西莫夫提出的三大定律!这组定律简直像给机器人戴上了"紧箍咒",具体来说:第一定律超级硬核——机器人绝对不能伤害人类,看到人类遇险还得赶紧救援;第二定律强调服从性,机器人要乖乖听人类指挥,但前提是不能违反第一定律;第三定律则给了机器人自我保护的权利,不过必须在遵守前两条的基础上。啧啧,这三条环环相扣的设定,后来成了无数科幻作品的"黄金标准"呢!

三定律核心内容与无人驾驶应用

-

伤害预防是头等大事

哇塞,第一条定律直接划出红线——人类安全至高无上!就像无人驾驶汽车遇到突发状况时,系统必须优先考虑行人安全,哪怕要牺牲车辆本身。这种"舍己为人"的逻辑现在正被写进自动驾驶的安全标准里。 -

指令服从要有底线思维

比方说乘客命令无人车闯红灯,系统就得根据第二定律拒绝执行——因为违反交规会危及人类安全呗!不过现在很多智能车已经能做到在非危险情况下乖乖听车主指挥,比如自动泊车、切换路线这些操作。 -

自我保护不能越界

有意思的是第三定律允许机器人"惜命",比如无人车检测到电池过热会自动降速。但要是遇上必须紧急避让行人的情况,就算可能造成车辆损毁也得果断行动,毕竟前两条定律才是老大!

相关问题解答

-

机器人三定律现在还有现实意义吗?

当然有啊!现在满大街的扫地机器人、智能音箱都在隐形遵守这些规则。比如说语音助手听到疑似家暴的动静会自动报警,这就是第一定律的实践。科技公司设计产品时都得琢磨这些伦理底线,不然搞出个乱来的AI可就麻烦大了! -

无人车遇到"电车难题"怎么办?

哎呦这可是个烫手山芋!现在工程师们的解法是给三定律加"补丁"——比如让车载AI学习海量事故数据,形成更精细的判断逻辑。具体来说,系统会综合计算碰撞概率、伤亡风险等几十个参数,尽可能选出伤害最小的方案。不过说到底,还是得靠法规和技术双管齐下才行。 -

未来AI会突破三定律限制吗?

这事儿谁也不敢打包票!但业界早就未雨绸缪了,像欧盟正在推的《人工智能法案》就要求高风险AI必须内置"紧急制动"功能。其实阿西莫夫自己后来也补充了第零定律——机器人不得伤害人类整体利益。看来人类对AI的约束机制会像打补丁一样不断升级呢! -

普通用户需要了解这些定律吗?

太需要了好吗!就像现在很多人会好奇"智能门锁会不会突然把我锁外面",了解三定律就能明白这类产品设计时已经埋了安全机制。下次看到无人机自动避让行人,你就能会心一笑:"嘿,这不是第二定律在起作用嘛!"

评论